深度學習熱潮必備三元素

2024/11/8 下午2:02

華盛頓郵報前記者Timothy B Lee講述了深度學習熱潮離不開的三個關鍵元素,讓我們一起看看深度學習熱潮背後的故事。

1、故事開篇

在2008年,Timothy B Lee在普林斯頓大學攻讀計算機科學研究生,選了一門人工智慧課程。課程接近尾聲時,有一節關於神經網路的講座。當時他的感覺是,神經網路已經過時了,大多數研究者都傾向於支持向量機等偏數學的方法。

2、第一個關鍵元素

就在同一棟教學樓裡,李飛飛教授正悄悄地進行著一項將改變整個領域的工作。她並沒有試圖改進神經網路算法,而是專注於構建一個前所未有的大型圖像數據集:ImageNet。這個數據集包含了1400萬張圖像,覆蓋了近22000個類別。當時她的想法是,或許算法的瓶頸並不在於模型本身,而在於缺乏足夠的訓練數據。

然而,李飛飛的這個想法並不被廣泛認可。許多同事和導師都認為她走得太遠了,現有的算法無法利用如此龐大的數據集。即便如此,她依然堅持完成這個項目。她利用了亞馬遜的Mechanical Turk平台,動員全球的勞動力對圖像進行標注。這個過程耗費了兩年多的時間,也幾乎耗盡了她的研究經費。

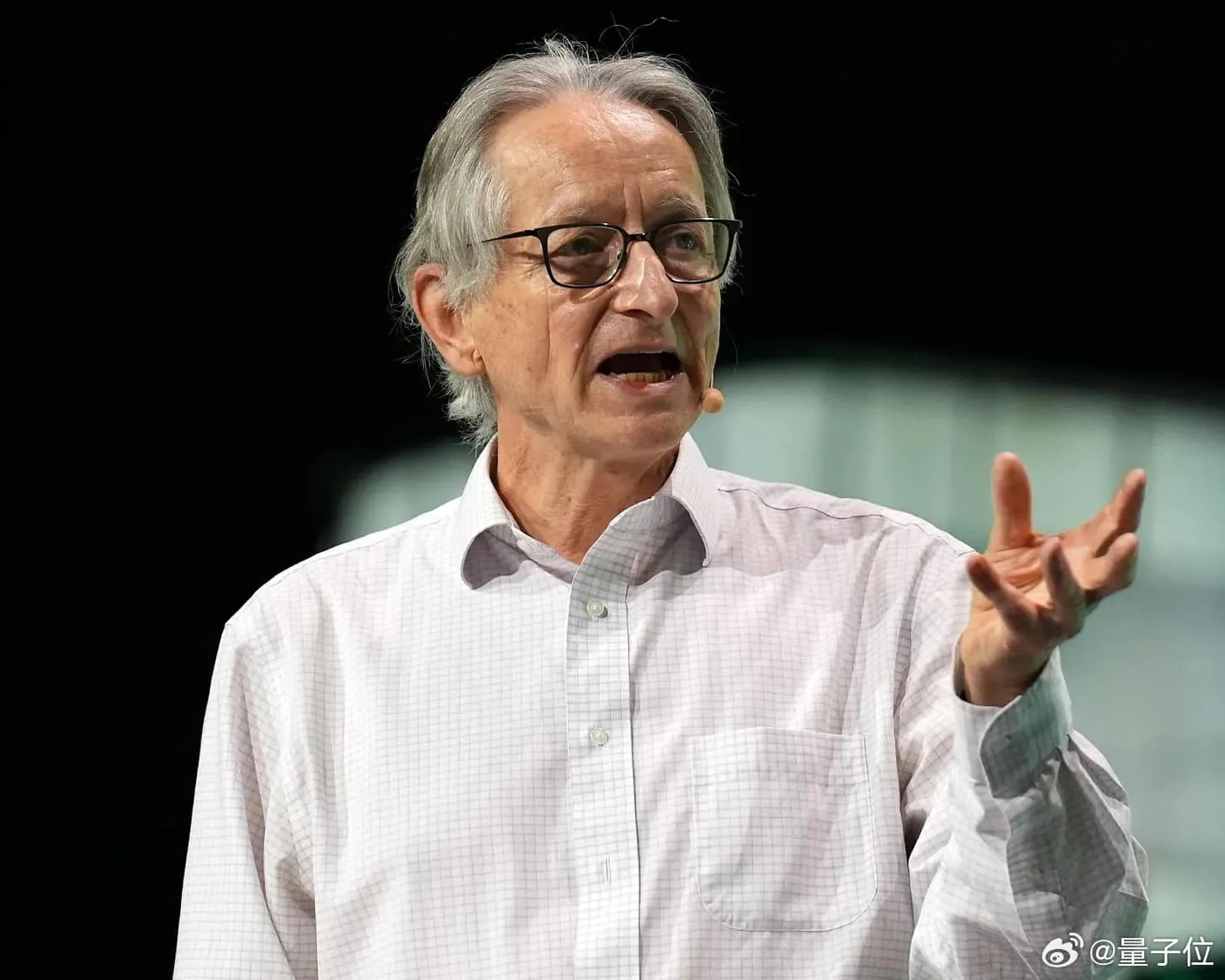

3、第二個關鍵元素

多倫多大學的傑弗里·辛頓(Geoffrey Hinton)教授一直堅信神經網路的潛力。早在1986年,他就和同事提出了反向傳播算法,為訓練深層神經網路提供了可能。然而,由於計算能力的限制和數據的匱乏,神經網路的發展一度陷入停滯。

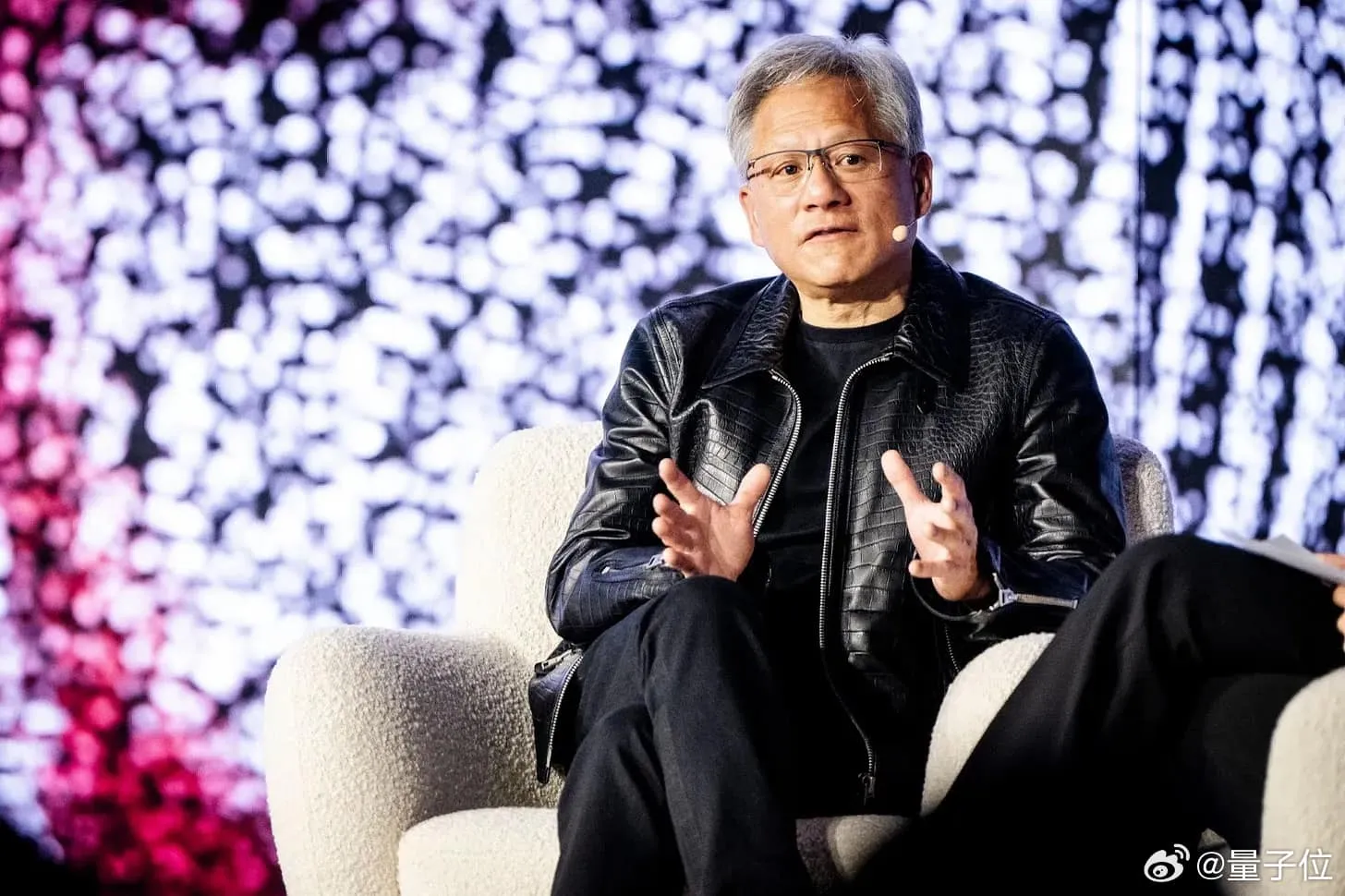

4、第三個關鍵元素

說到深度學習的第三個關鍵,不得不提到英偉達的CEO黃仁勳。他在2006年推出了CUDA平台,使得GPU可以用於通用計算,而不僅僅是圖形渲染。儘管最初這個想法並不被看好,但卻為後來神經網路的高速訓練提供了強大的計算支持。

集齊三元素後,真正的突破發生在2012年。

在那一年的ImageNet競賽中,辛頓(Hinton)的學生Alex Krizhevsky和Ilya Sutskever利用GPU訓練了一個深度神經網路模型,也就是後來的AlexNet。他們的模型在圖像識別任務上取得了前所未有的成績,準確率大幅領先於其他參賽者。這一成果震驚了整個電腦視覺領域,曾經被認為是「陳舊」的神經網絡,在龐大數據集和強大計算力的支持下,竟然展現出了如此巨大的潛力。

由此看來,深度學習的崛起並非源自某一個突破性的技術創新,而是來自於三個關鍵元素的意外融合,即——

一、龐大的數據集 二、有效的訓練算法 三、強大的計算能力

雖然這些元素在當時都不被主流所看好,但當它們結合後,卻引發了人工智慧領域的革命。

轉載自「量子位」(發布於20241107)

0 則留言